L’arrivée de la puce WSE-3 de Cerebras dans les services IA d’AWS suscite un vif intérêt. Cette puce, réputée pour sa puissance, va révolutionner le traitement des prompts complexes. Son intégration accélérera les réponses génératives.

La dynamique se fonde sur un partenariat pluriannuel entre AWS et Cerebras. Les deux entreprises entendent poser de nouveaux jalons en inférence désagrégée. Leur objectif est d’offrir cinq fois plus de rapidité.

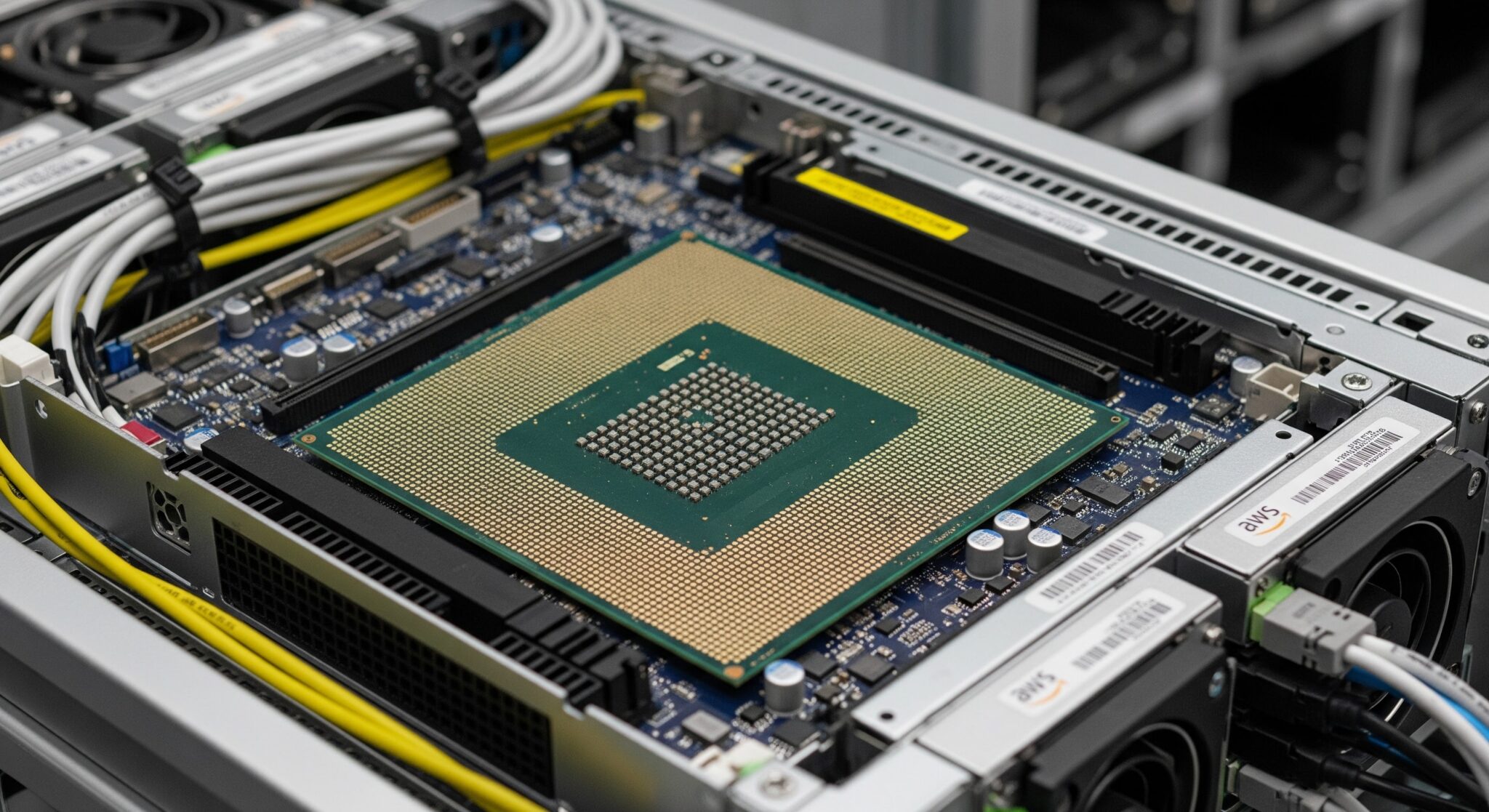

Fonctionnement révolutionnaire de la puce WSE-3 chez AWS

Le composant WSE-3 met en œuvre 900 000 cœurs et 44 Go de mémoire cache. Il atteint 125 pétaflops en précision 16 bits, idéals pour l’inférence IA haute performance. Selon un article analysant cette architecture, sa connexion rapide se réalise via l’interface EFA. L’inférence exascale y devient alors plus abordable. Cette philosophie technique se combine avec Trainium3 pour traiter prefill et decode distinctement.

Les serveurs CS-3 hébergent la puce sur un wafer unique, occupant presque la moitié du châssis. AWS compte déployer cette solution dans ses datacenters pour améliorer la rapidité des modèles génératifs. En janvier 2026, OpenAI avait déjà réservé ces mêmes machines, estimant l’opération à dix milliards de dollars. Sesterce, en revanche, fait face à un redressement judiciaire pour des factures impayées. Cette différence illustre le contraste entre adoption massive et difficultés financières.

Nouveaux services IA d’AWS avec la puce WSE-3

Nul ne peut le nier, AWS mise sur Bedrock pour proposer le meilleur de l’inférence désagrégée. Ce service permet, en effet, d’accéder au prefill sur Trainium3 et au decode sur WSE-3. Cette solution hébergée cible à la fois Nova et ChatGPT, assurant une flexibilité optimale. Les deux moteurs se coordonnent via l’EFA, garantissant un flux de données rapide. En conséquence, diverses organisations profitent déjà d’une IA plus réactive.

Pourtant, tout le secteur ne connaît pas le même élan positif. Google Antigravity essuie actuellement des plaintes au sujet d’un changement de facturation jugé brutal. Des quotas d’utilisation ont été drastiquement réduits, forçant certains développeurs à migrer vers des offres plus onéreuses. Sur Reddit, des témoignages relatent l’impossibilité de dépasser neuf millions de jetons hebdomadaires. Cette situation pousse des acteurs à envisager d’autres plateformes, dont AWS.

Perspectives et enjeux futurs autour de la WSE-3

Andrew Feldman, fondateur de Cerebras, prévoit de livrer ces puces géantes dans chaque région AWS d’ici fin 2026. Il estime que la demande en ressources IA augmentera encore, justifiant l’investissement. L’infrastructure requiert un refroidissement particulier, à base d’eau à 20°C circulant à fort débit. ChatGPT fait également partie des bénéficiaires, puisque son code s’adapte à cette architecture. Voilà comment Cerebras compte tenir ses promesses sur la scène mondiale.

La commande d’OpenAI, étalée jusqu’en 2028, couvre près de 28 000 serveurs CS-3 totalisant 750 MW. Cette puissance confirme la volonté de divers acteurs d’exploiter les capacités hors norme du WSE-3. Les retombées concernent aussi la maintenance et l’optimisation énergétique, deux piliers cruciaux. Plusieurs cabinets financiers ont ainsi soutenu Cerebras avec un financement considérable. Les prochaines années s’annoncent déterminantes pour élargir l’accès à cette technologie. Des retours sur investissement sont attendus, car chaque puce exploite ses cœurs au maximum. La synergie entre Cerebras et AWS pourrait intensifier la concurrence face à d’autres fournisseurs IA.

- Partager l'article :